苹果电脑ollama安装包下载总失败,不用灰心,ollama官网下载链接很不稳定,小编给大家分别带来了windows安装包和mac安装包,以及linux安装包;deepseek mac本地部署可以靠安装Ollama来实现,作为开源llm大语言模型,ollama深受不少用户喜欢,尤其是deepseek火了之后,很多用户都下载ollama配置deepseek,快来下载体验吧,本站的ollama安装包是最新版本。

Ollama是什么

Ollama是一个开源的 LLM(大型语言模型)服务工具,用于简化在本地运行大语言模型,降低使用大语言模型的门槛,使得大模型的开发者、研究人员和爱好者能够在本地环境快速实验、管理和部署最新大语言模型,包括如Llama 3、Phi 3、Mistral、Gemma等开源的大型语言模型。

ollama安装包背景

Ollama是可以在macOS、Linux和Windows系统上运行的跨平台工具,它帮助用户快速在本地运行大模型,极大地简化了在Docker容器内部署和管理LLM(大型语言模型)的过程。

Ollama支持的大模型列表部分

ollama mac使用教程

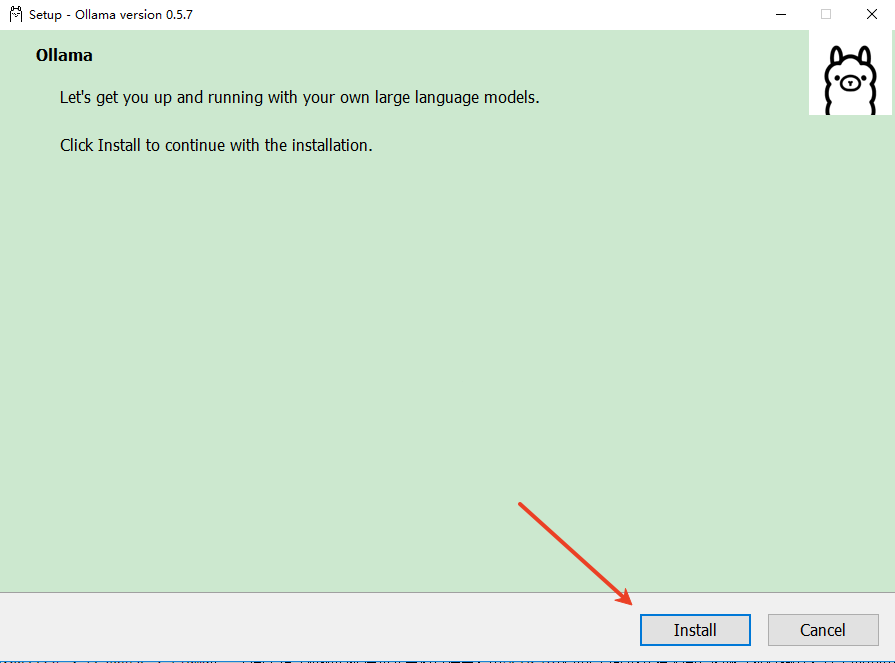

配置Ollama

修改模型存储路径:

Ollama默认将模型存储在C盘。为了节省C盘空间或提高访问速度,您可以修改模型的存储路径。右键点击Ollama图标,退出Ollama,然后打开“系统环境变量”,新建一个系统变量OLLAMA_MODELS,并设置为您希望的模型存储路径。

修改API访问地址和端口:

Ollama API的默认访问地址和侦听端口是http://localhost:11434。如果您需要在网络中提供服务,请修改API的侦听地址和端口。在系统环境变量中设置相应的变量值即可。

允许浏览器跨域请求:

如果您计划在其它前端面板中调用Ollama API(如Open WebUI),建议放开跨域限制。可以新建一个系统变量OLLAMA_ORIGINS,并设置变量值为*。

启动和运行Ollama

启动Ollama:

在开始菜单中找到Ollama,并点击启动。或者右键点击桌面右下角的Ollama图标,选择“启动”。

查看Ollama命令:

以管理员身份运行Windows Powershell,执行ollama命令来查看Ollama的帮助信息和可用命令。

下载并运行大模型:

执行ollama list命令可以查看当前安装的大模型列表。如果需要下载新的大模型,可以前往Ollama模型库选择合适的模型,并执行相应的安装命令。例如,执行ollama run [modelname]命令来下载并运行指定的大模型。

验证安装:

为了验证Ollama是否启动成功,可以在浏览器中访问http://127.0.0.1:11434/(或您设置的API端口)。如果显示“Ollama is running”,则说明Ollama已成功启动。

通过以上步骤,您就可以完成Ollama的下载、安装和配置,并开始使用Ollama来运行大型语言模型了。请注意,在使用过程中,如果遇到任何问题或疑问,可以查阅Ollama的官方文档或寻求社区的帮助。

腾讯会议Mac版

腾讯会议Mac版 ParallelsDesktop26forMac

ParallelsDesktop26forMac 企业微信mac版本

企业微信mac版本 QQ音乐formac

QQ音乐formac SmartFTP(FTP文件传输客户端)

SmartFTP(FTP文件传输客户端) Illustrator2025Mac中文版

Illustrator2025Mac中文版 思源笔记Mac版

思源笔记Mac版 火星小说电脑版「含模拟器」

火星小说电脑版「含模拟器」 口袋原油电脑版「含模拟器」

口袋原油电脑版「含模拟器」 易次元电脑版「含模拟器」

易次元电脑版「含模拟器」 高考满分作文电脑版「含模拟器」

高考满分作文电脑版「含模拟器」 高考直通车电脑版「含模拟器」

高考直通车电脑版「含模拟器」

剪映Mac版

剪映Mac版 口袋对战宝典电脑版「含模拟器」

口袋对战宝典电脑版「含模拟器」 向日葵企业版控制端Mac版

向日葵企业版控制端Mac版

千问MAC版

千问MAC版

网易UU加速器mac版

网易UU加速器mac版

Edge浏览器Mac版

Edge浏览器Mac版

阿里卖家Mac版

阿里卖家Mac版

CAD快速看图Mac版

CAD快速看图Mac版

威力导演Mac版

威力导演Mac版

火狐浏览器Mac版

火狐浏览器Mac版

VisualStudioCodeMAC版

VisualStudioCodeMAC版

搜狐影音mac版

搜狐影音mac版

腾讯QQMac版

腾讯QQMac版

VueScanmac版

VueScanmac版

抖音mac版

抖音mac版

AutoCADLT2026Mac版

AutoCADLT2026Mac版

中移移动办公Mac版

中移移动办公Mac版

夸克Mac版

夸克Mac版

优酷视频mac版

优酷视频mac版

谷歌浏览器Mac版

谷歌浏览器Mac版

zTasker电脑版

zTasker电脑版 单文件制作工具

单文件制作工具 MAXHUB传屏助手电脑版

MAXHUB传屏助手电脑版 沙漏验机电脑版

沙漏验机电脑版 HofoSetup(安装包制作大师)

HofoSetup(安装包制作大师) 斗鱼直播管家电脑版

斗鱼直播管家电脑版 广发金融终端

广发金融终端 南京证券鑫易通交易软件

南京证券鑫易通交易软件 大智慧策略投资终端

大智慧策略投资终端 天风高财生电脑版

天风高财生电脑版 汇通启富金融终端

汇通启富金融终端 Prepros(前端开发工具)

Prepros(前端开发工具) 儿时的街机游戏

儿时的街机游戏

拼图游戏大全

拼图游戏大全

原神

原神

生活实用APP

生活实用APP